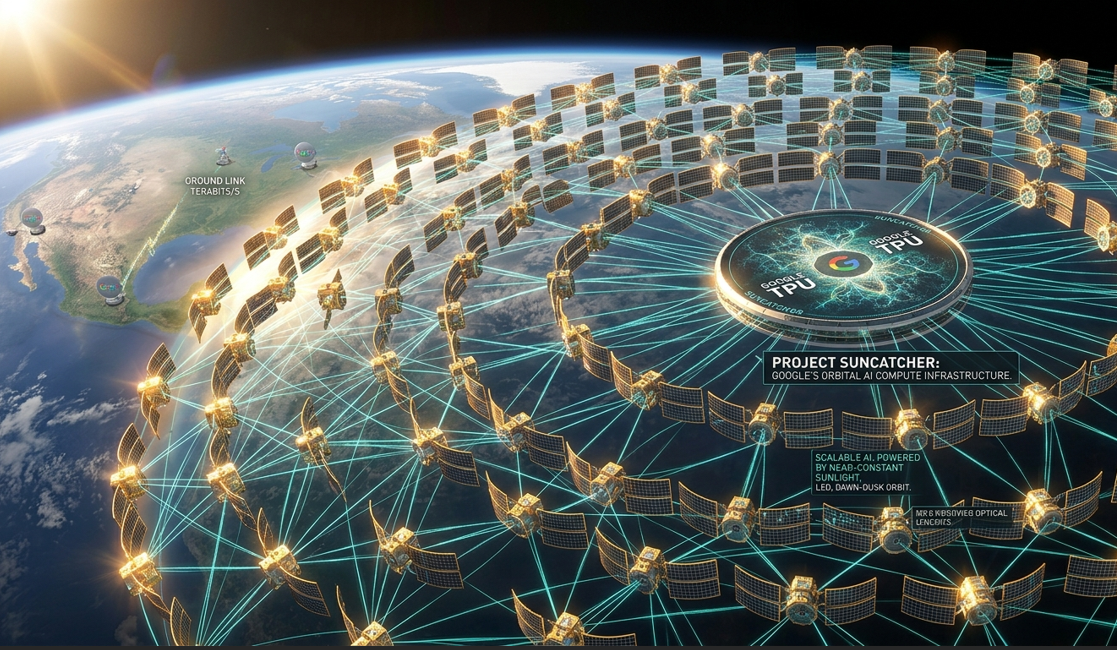

Google acaba de anunciar lo que parece sacado de una novela de ciencia ficción: Project Suncatcher, su nuevo «moonshot» (proyecto de alto riesgo) para construir centros de datos de inteligencia artificial en el espacio . La idea es tan audaz como fascinante: constelaciones de satélites equipados con chips TPU, alimentados por energía solar y conectados mediante láseres, orbitando a 650 km de altura .

¿Por qué diablos llevar la IA al espacio?

La respuesta es sencilla y a la vez aterradora: la IA se está comiendo el planeta. Literalmente.

Los centros de datos terrestres ya consumen más del 4% de la electricidad de Estados Unidos, y se espera que esa cifra alcance el 12% en 2028 . Para que te hagas una idea, el consumo energético de la IA equivale al de ciudades enteras como Alcobendas o Barakaldo . Además, necesitan enormes cantidades de agua para refrigerarse, compiten con los ciudadanos por el acceso a la red eléctrica y, en algunos casos, enfrentan colas de conexión de hasta siete años .

Project Suncatcher propone una solución elegante: llevar el problema al único lugar donde la energía es infinita y el frío del espacio hace de refrigerante natural. En la órbita adecuada, un panel solar es hasta 8 veces más eficiente que en la Tierra y produce energía de forma casi continua . Google estima que, para mediados de la década de 2030, operar un centro de datos en órbita podría costar lo mismo que uno terrestre .

Cómo funciona la ingeniería detrás del sueño

Aquí es donde el proyecto parece técnicamente brillante. No se trata de un solo satélite gigante, sino de enjambres de satélites pequeños que trabajan juntos . El plan actual contempla clusters de unos 81 satélites volando en formación apretada, separados por apenas 100 o 200 metros .

La clave de todo es la comunicación entre ellos. Google ha diseñado un sistema de enlaces ópticos de espacio libre (básicamente, láseres) capaces de transmitir datos a velocidades de decenas de terabits por segundo . En pruebas en tierra, ya han logrado 1.6 Tbps bidireccionales. Para que esto funcione en órbita, los satélites deben volar muy cerca unos de otros (a menos de un kilómetro de distancia), pero los modelos de Google demuestran que es factible mantener esa formación con maniobras de propulsión modestas .

La sorpresa los chips TPU aguantan más de lo esperado

Uno los mayores escepticismos iniciales era la radiación. El espacio es un entorno hostil: partículas de alta energía que pueden freír cualquier electrónica en cuestión de meses. Pues bien, Google sometió sus chips TPU v6e «Trillium» a un haz de protones de 67 MeV simulando cinco años en órbita .

Los resultados son asombrosos. La memoria HBM (el componente más sensible) solo empezó a dar problemas después de una dosis tres veces superior a la esperada en la misión. Y no se produjeron fallos catastróficos hasta llegar a 15 krad(Si), muy por encima de lo necesario . Google no necesita rediseñar sus chips desde cero; los que ya tiene son sorprendentemente resistentes a la radiación.

Los desafíos que preocupan

No todo es color de rosa. Si hay que ser honestos, hay tres aspectos que me generan dudas razonables:

- La refrigeración en el vacío: En la Tierra usamos aire o agua para enfriar los chips. En el espacio, solo queda la radiación térmica. Google dice que disiparán el calor mediante radiadores, pero un centro de datos de IA genera un calor bestial. ¿Serán suficientes? El propio Sundar Pichai reconoce que la «gestión térmica» es uno de los desafíos pendientes .

- El coste de lanzamiento: Google confía en que bajará a 200 dólares por kg para 2035 . Hoy en día, sigue siendo mucho más caro. Y aunque bajara, ¿quién va a lanzar cientos o miles de satélites? La capacidad de lanzamiento no es infinita .

- El mantenimiento: Si un servidor se estropea en un centro de datos terrestre, un técnico lo reemplaza en minutos. En el espacio, no hay «técnicos». Un satélite que falla es basura espacial. La fiabilidad a largo plazo es un interrogante mayúsculo.

Project Suncatcher no es una excentricidad de Google. Es la respuesta más lógica a un problema real que ya estamos viviendo. La demanda energética de la IA está creciendo más rápido que nuestra capacidad de generar electricidad de forma sostenible en la Tierra.

Google ha demostrado en el pasado que los «moonshots» pueden funcionar: Waymo (coches autónomos) empezó como una locura y hoy transporta millones de pasajeros . La computación cuántica era ciencia ficción y ahora es una realidad incipiente.

Los primeros prototipos se lanzarán en colaboración con Planet a principios de 2027 . Serán dos satélites pequeños para probar los enlaces láser y el comportamiento de los TPU en el espacio real. Si esa misión tiene éxito, en diez años podríamos tener los primeros centros de datos orbitales operativos .

Mi puntuación: 7/10 por ahora. Le doy un 7 porque la idea es sólida, la tecnología base ya existe (TPUs resistentes, enlaces ópticos de alta velocidad, costes de lanzamiento en caída) y el problema que resuelve es real y urgente. Pero los desafíos de refrigeración, fiabilidad y logística son todavía demasiado grandes como para darle un aprobado completo.

Eso sí: si dentro de cinco años esto funciona, habrá cambiado las reglas del juego de la computación para siempre. Y yo, desde aquí, estaré mirando al cielo con una sonrisa.